Je hebt AI geprobeerd voor je strategie. Het resultaat klonk slim, maar voelde generiek. Alsof iemand een strategieboek had samengevat en er jouw bedrijfsnaam overheen had geplakt. Herkenbaar? Dan ben je niet de enige.

78% van de organisaties gebruikt AI inmiddels in ten minste één bedrijfsfunctie1. Maar 70-85% van AI-initiatieven faalt om de verwachte uitkomsten te bereiken2. En 42% van bedrijven heeft het merendeel van hun AI-initiatieven in 2025 stopgezet2.

Dat is geen technologieprobleem. Het is een contextprobleem.

Waarom AI faalt bij strategische planning

De belofte is verleidelijk: AI die je complete strategie schrijft, marktanalyses uitvoert en je vertelt welke beslissingen je moet nemen. Maar AI kent je organisatie niet. Het weet niet welke doelen je team najaagt, welke initiatieven lopen, waar de knelpunten zitten, of wat vorig kwartaal wel en niet werkte.

Zonder die context doet AI wat het kan: generieke antwoorden geven op basis van algemene patronen. Niet omdat AI slecht is, maar omdat je het vraagt strategisch te denken zonder strategische informatie.

Harvard onderzoek bevestigt dit patroon. AI-systemen leren van datasets die zelf producten zijn van menselijke besluitvorming3. Wanneer die data onvolledig of generiek is, produceert AI onvermijdelijk generieke output. Onderzoekers van Harvard’s Digital Data Design Institute vonden dat “individuele generatieve AI-evaluaties inconsistent en bevooroordeeld zijn” wanneer de input ongestructureerd is4.

48% van organisaties noemt doorzoekbaarheid van data als grootste obstakel voor AI-agents5. Tot 70% van de inspanning bij AI-oplossingen gaat naar data ordenen en harmoniseren6. Het probleem is niet de AI. Het probleem is dat organisaties hun eigen context niet beschikbaar hebben gemaakt.

35% van organisaties heeft geen formele AI-strategie5. Dat klinkt als een achterstand, maar het is ook een kans: als je begint met structuur in plaats van technologie, hoef je geen complexe AI-strategie te formuleren. Je hoeft je organisatiekennis alleen toegankelijk te maken.

Waar AI wel waarde toevoegt

AI is niet nutteloos voor strategie. Het is nutteloos voor strategie zonder context. Zodra je AI de juiste input geeft, verschuift het beeld.

Externe analyse en patroonherkenning

AI kan grote hoeveelheden externe informatie verwerken: markttrends, concurrentiebewegingen, technologische verschuivingen. Taken die voorheen dagen kostten, gebeuren nu in uren. Hier hoeft AI je organisatie niet te kennen, het analyseert publieke data.

Blinde vlekken identificeren

Wanneer je AI je strategie voorlegt in gestructureerde vorm, kan het feedback geven op mogelijke hiaten. Welke aannames maak je impliciet? Welke risico’s heb je niet overwogen? Maar dit werkt alleen als de input gestructureerd genoeg is om zinvol te evalueren.

Optiegeneratie binnen kaders

AI functioneert als een sparringpartner die nooit moe wordt, maar de kwaliteit van het gesprek hangt volledig af van de kaders die je meegeeft. “Help me brainstormen over onze strategie” levert generieke output. “Gegeven deze drie strategische doelen, deze KPI’s, en deze kwartaalresultaten, welke aanpassingen stel je voor?” levert bruikbaar advies.

Het verschil zit in de richting

Onderzoek van Ascarza en Israeli aan Harvard Business School toont aan dat AI bestaande patronen versterkt door schaal7. Dat is een risico bij generiek gebruik: AI vergroot je blinde vlekken. Maar het is een voordeel bij gestructureerd gebruik: AI versterkt dan je strategische focus.

Het contextprobleem oplossen

Gartner voorspelt dat meer dan 40% van alle agentic AI-projecten tegen eind 2027 wordt geannuleerd8. De primaire oorzaken: escalerende kosten, onduidelijke business value, en inadequate risicobeheersing. Niet technische limitaties, maar strategische missers.

Organisaties met hoge AI-maturiteit doen het anders. In 57% van hoog-mature organisaties vertrouwen business units nieuwe AI-oplossingen, vergeleken met slechts 14% in laag-mature organisaties8. Het verschil? Die organisaties hebben hun strategische context gestructureerd voordat ze AI erop loslieten.

McKinsey vond dat wanneer CEO’s of boards AI-governance bezitten, organisaties meer waarde realiseren1. Maar governance begint niet met beleid. Het begint met data. En strategische data begint met structuur.

Hier zit het inzicht dat de meeste AI-implementaties missen: je hoeft geen AI-strategie te formuleren. Je moet je strategische context structureren zodat AI er iets mee kan.

De template als datamodel

Bij dare2plan gebruiken we canvassen en templates als structureel fundament. Niet als invuloefening, maar als datamodel voor je organisatie.

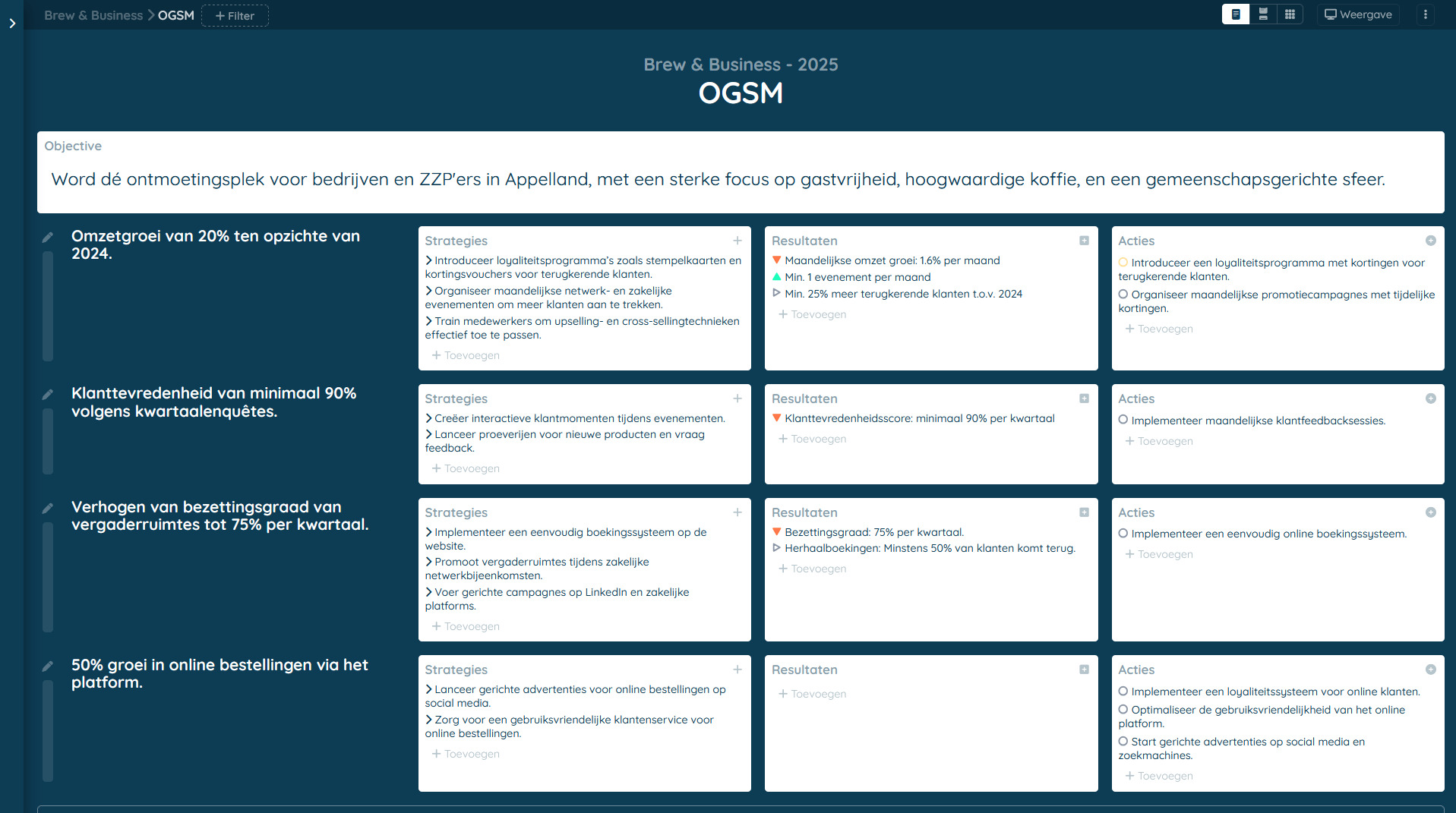

Wanneer je team een strategisch canvas invult, of het nu een OGSM, jaarplan, of balanced scorecard is, creëer je precies de gestructureerde context die AI nodig heeft. Je doelen, KPI’s, acties en resultaten zijn dan geen losse documenten in een gedeelde drive. Ze zijn gestructureerde, doorzoekbare data.

De template is het datamodel. Het canvas is de backbone.

Waar 48% van organisaties worstelt met het doorzoekbaar maken van hun data voor AI5, structureert een ingevuld canvas die data vanaf het moment van creatie. Geen data-migratie achteraf. Geen weken aan integratie. De structuur zit in het proces zelf.

Dat werkt in twee richtingen. Je team krijgt een helder strategisch overzicht op één pagina. En je creëert tegelijkertijd de gestructureerde context die AI nodig heeft om van generiek naar relevant te gaan.

Wat er verandert als je context op orde is

Naarmate AI meer wordt geïntegreerd in strategische processen, wordt automation bias een reëel risico: de neiging om te zwaar te leunen op geautomatiseerde aanbevelingen9. Gestructureerde context beschermt daartegen. Als je team de strategie zelf heeft geformuleerd in een canvas, hebben ze een referentiekader om AI-output tegen te toetsen.

McKinsey schat een productiviteitsboost van $4,4 biljoen door AI in de komende jaren1. Maar het realiseren van die waarde vereist het schalen van pilots naar productie. En schalen vereist structuur.

45% van organisaties met hoge AI-maturiteit houdt AI-projecten minstens drie jaar operationeel, vergeleken met 20% in laag-mature organisaties8. Die houdbaarheid komt niet van betere technologie. Die komt van een betere basis: gestructureerde data, heldere processen, en teams die hun eigen strategie kennen.

Jouw volgende stap

AI in strategische planning is geen hype. Maar het is ook geen plug-and-play oplossing. De 78% adoptie versus 85% faalpercentage vertelt je alles: de technologie is er, de context niet.

Begin niet met AI. Begin met structuur. Breng je strategie, doelen en acties samen in één gestructureerd overzicht. Niet als document dat in een la verdwijnt, maar als levend canvas dat je team gebruikt en dat, zodra je er klaar voor bent, je AI de context geeft die het nodig heeft.

Bekijk de dare2plan template bibliotheek en kies het canvas dat past bij je situatie. Eén ingevuld canvas is meer waard dan tien AI-experimenten zonder structuur.

In volgende artikelen duiken we dieper in specifieke frameworks en hoe ze je strategische planning versterken, met en zonder AI.

Referenties

-

McKinsey & Company (2025). The state of AI in 2025: Agents, innovation, and transformation. mckinsey.com ↩ ↩2 ↩3

-

MIT & RAND Corporation research, geciteerd in Aristek Systems (2025). AI 2025 Statistics: Where Companies Stand and What Comes Next. aristeksystems.com ↩ ↩2

-

Harvard Medical School (2024). Confronting the Mirror: Reflecting on Our Biases Through AI in Health Care. hms.harvard.edu ↩

-

Harvard Digital Data Design Institute (2025). The Promise and Pitfalls of AI in Strategic Decision-Making. d3.harvard.edu ↩

-

Deloitte (2025). The State of Generative AI in the Enterprise. deloitte.com ↩ ↩2 ↩3

-

McKinsey & Company (2023). Rewired: The McKinsey Guide to Outcompeting in the Age of Digital and AI. mckinsey.com ↩

-

Ascarza, E. & Israeli, A. Harvard Business School. When Bias Creeps into AI, Managers Can Stop It by Asking the Right Questions. hbs.edu ↩

-

Gartner (2025). Survey Finds 45% of Organizations With High AI Maturity Keep AI Projects Operational for at Least Three Years. gartner.com ↩ ↩2 ↩3

-

Springer (2025). Exploring automation bias in human–AI collaboration: a review and implications for explainable AI. springer.com ↩